“幽灵文献”

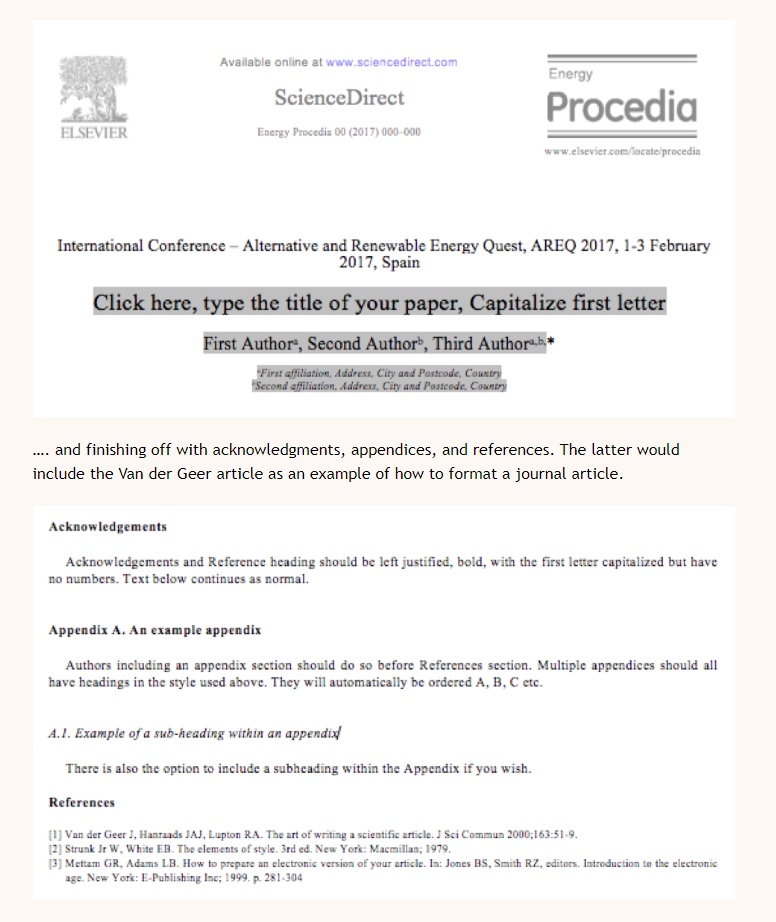

在文章“The mystery of the phantom reference(幽灵引用之谜)”中,作者发现爱思唯尔期刊的投稿指南在说明如何标注一篇参考文献时用了以下示例:

实际上,这篇文章并不存在,只是为了提供标注文献的参考格式而创建。即便如此,截至2017年10月,在Web of Science 中有近 400 篇文章引用了这个不存在的参考文献。而引用它的研究人员所涉及的学科范围之广则跨越了若干主题:从半导体,电凝,到血压,或抗癌药物等。

作者在引用这篇文献的论文中发现了共通之处:近 90%的文章出现在会议记录里,其中约三分之二在爱思唯尔出版的会议论文集Procedia conference volumes上发表,文集包含了 25 个不同学科。进一步调查后,作者检索到一个会议列出的投稿模板将Van der Geer和Hanraads的“幽灵文献”用作了展示期刊格式要求的范例。

显然,论文作者应该将每个部分的模板文本替换成他们自己的内容。但一些英语语言能力较差或经验不足的作者可能没有发现这一点,或是在完成自己的文献列表后忘了将其删除。这个推测很有可能是真的,因为在被检查论文中,社会科学的作者也把其他范例的文本(一本书和书的章节)留在了两篇文章的文献列表里。

调查进行到这里,“幽灵引用之谜”的谜底非常简单:学术论文在写作与质量把控过程中的草率与疏忽。

“幽灵文献”新形态:AI生成工具的副产物

甚至能为自己虚构的文献“寻找”真实作者:

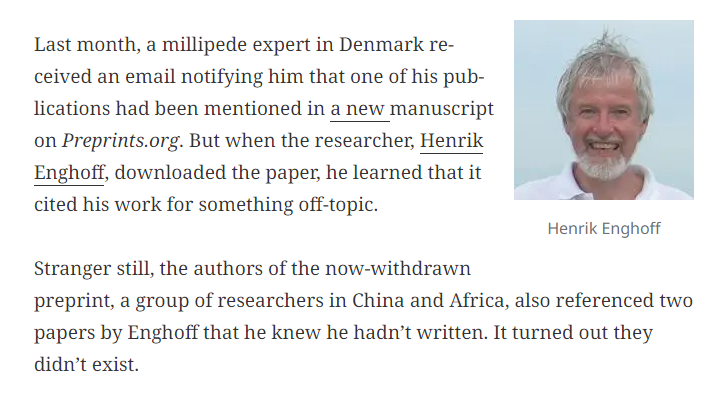

2023年6月,丹麦专家亨里克·恩霍夫(Henrik Enghoff)收到一封电子邮件,通知他一篇发布在Preprints.org的新论文中引用了他的文章。

下载并查看论文后的老爷子:你这引用的内容不是我写的啊?

恩霍夫随即联系了哥本哈根大学的大卫·理查德·纳什(David Richard Nash)。纳什此前一直试验用ChatGPT查找科学文献的可行性。在得知恩霍夫的经历后,纳什在Preprints.org的预印本中随机查找了五个参考文献,发现它们都是虚构的。同时向平台发邮件告知稿件存在AI生成文本的可能。

AIGC工具:完善与创新发展相适应的科学监管方式

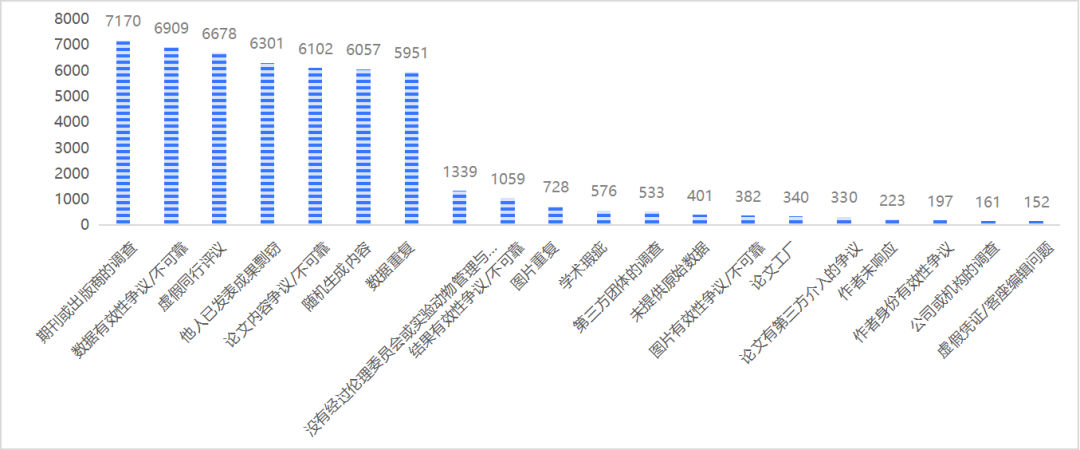

相似案件在近期ChatGPT等工具飞速发展的当下不胜枚举。在对2023年全球学术论文撤稿原因进行统计发现,去年因“随机生成内容”而撤稿的论文比例显著增加,与其它历年撤稿中的常见不端行为同样处于断崖式领先。

2023年全球学术论文撤稿涉及的原因(前20):

来源:万方数据科研诚信监测大数据

2023年9月,中国科学技术信息研究所联合爱思唯尔、施普林格·自然、约翰威立国际出版集团发布《学术出版中AIGC使用边界指南》,对各环节可否使用AIGC给出建议,以及详尽、规范的使用指导。

在《指南》正式发布前,国内已经开始对AI生成工具的使用加以规范。去年发布的《生成式人工智能服务管理暂行办法》指出,针对生成式人工智能服务要“完善与创新发展相适应的科学监管方式,制定相应的分类分级监管规则或者指引”;提交审议的《中华人民共和国学位法(草案)》更是明确提出,学位论文或者实践成果存在人工智能代写等学术不端行为的,“由学位授予单位撤销学位证书”。

万方文察-科技论文诚信风险综合察验服务集先进的算法模型、强大的数据资源底座为基础,提供科技论文诚信风险一站式便捷服务及文本相似性、图像复用、AIGC风险等多要素的综合察验。

在AI生成文本的检测上,文察使用基于深度学习的AIGC识别算法,可识别目前较为通用的AI写作模型,包括且不限于ChatGPT、文心一言、谷歌Bard、通义千问等AI写作助手生成的中文文本。